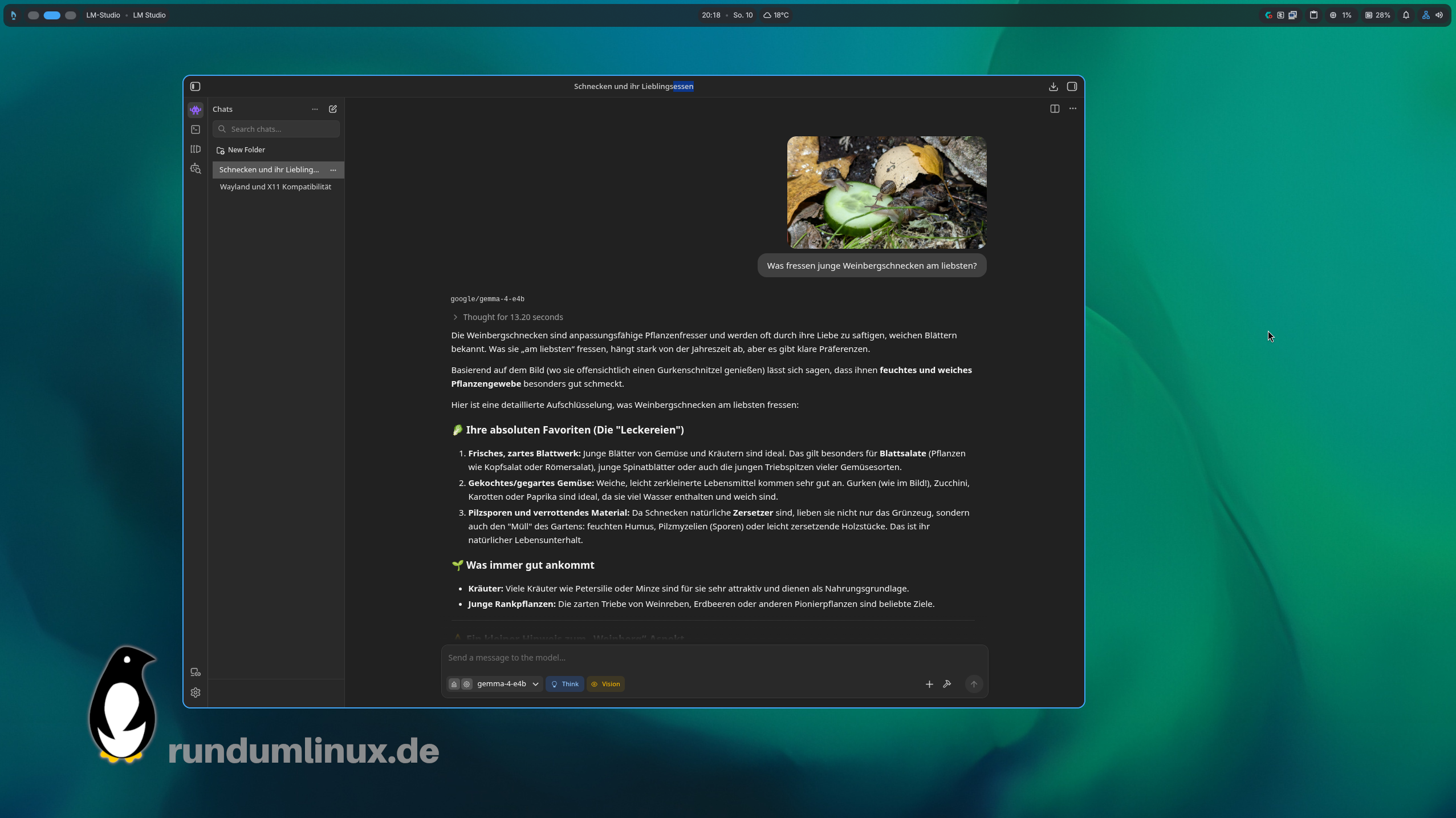

Ich habe so viele Fragen. Wie funktioniert der Winterschlaf bei Weinbergschnecken? Welche aktuellen Forschungsansätze gibt es zum Terraforming? Wie pflege ich mein Oregano? Welche Therapiemöglichkeiten gibt es bei verspannten Nacken? Und wie wächst eigentlich Topinambur? Und beim Lösen von Linux-Problemen kann KI ebenfalls helfen.

Menschen aus der Wissenschaft, dem Gartenbau, der Landwirtschaft oder der Physiotherapie haben weder Zeit noch Lust, mir diese Fragen in aller Tiefe zu beantworten. Und ich selbst habe nicht genug Lebenszeit, um all den Fragen im Netz nachzugehen, Quellen zu finden und sie alle zu lesen, um mir die Antworten daraus zu extrahieren. ChatGPT und Co. aber sind geduldig und wissen viel. Da ich Quellen prüfen, Studien und empfohlene Literatur nachlesen kann, sind sie der schnelle Einstieg ins Wissen.

KI lieber lokal nutzen

Aber natürlich will auch ich nicht alle Fragen Techfirmen wie OpenAI anvertrauen, die dadurch viel zuviel über mich erfahren. Deshalb sind lokale Sprachmodelle so ein großartiges Geschenk. Ein Chatbot läuft mit einem passenden Modell auch auf nicht so schnellen Rechnern – manchmal dauert das mit der Antwort dann halt eine Weile.

Unter Linux ist vieles davon schnell installiert. Zum Beispiel LMStudio. Das bietet eine grafische Oberfläche, um mit verschiedenen KI-Modellen zu chatten, die ich direkt mit dem Tool herunterladen kann. Achtung: KI-Modelle umfassen oft mehrere GByte, es muss also genug Platz auf der betreffenden Partition vorhanden sein.

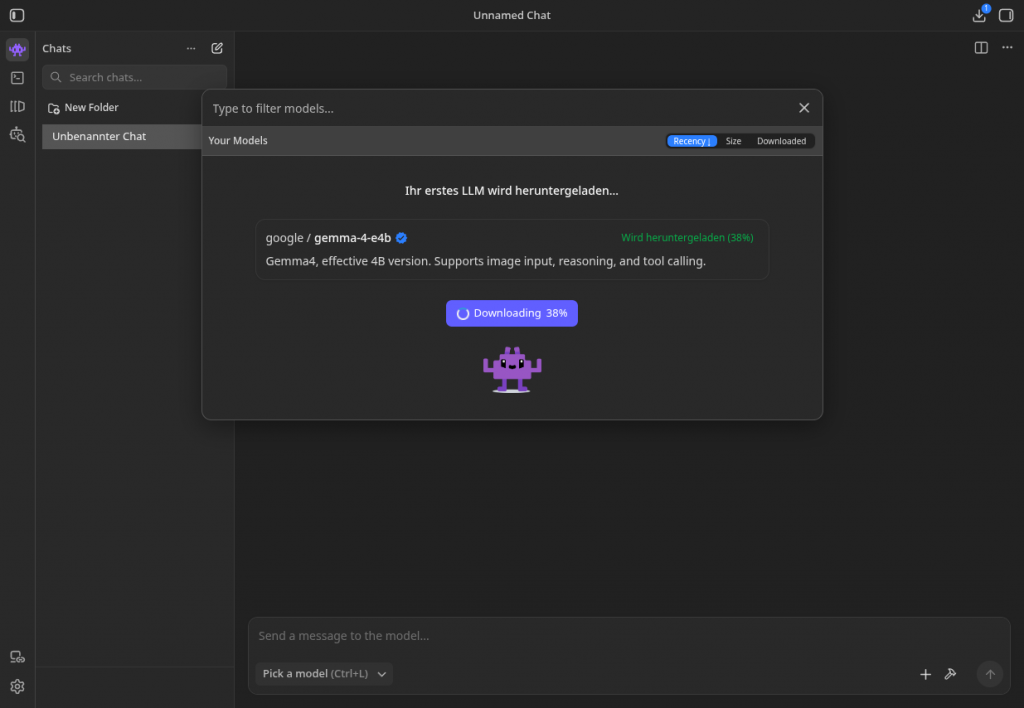

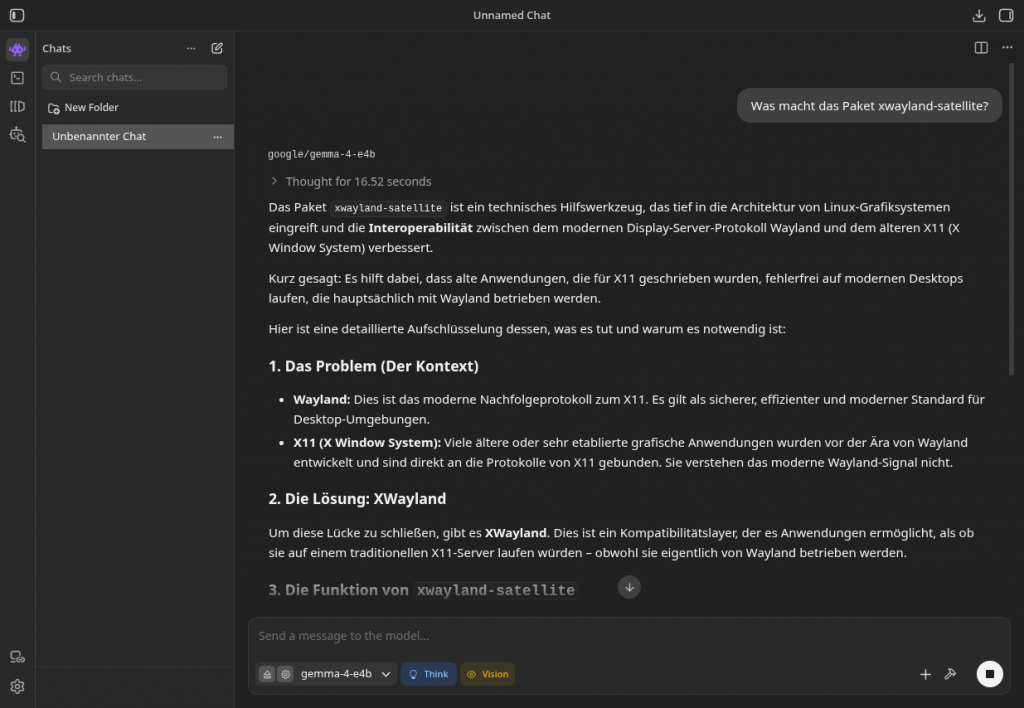

Die Installation von LMStudio ist denkbar einfach: AppImage herunterladen, Rechtsklick, dann in die Eigenschaften und dort zu den Zugriffsrechten und einen Haken bei „Der Datei erlauben, sie als Programm auszuführen“ und die Eigenschaften schließen. Je nach Dateimanager heißt das ein bisschen anders. Danach lässt sich das Tool per Doppelklick starten. Beim ersten Start schlägt LMStudio ein Modell vor, beispielsweise „google/gemma-4-e4b“ mit 6,33 GByte und bietet an, es herunterzuladen. Schließlich lande ich in einer Oberfläche, in der ich mit dem Modell chatten und bei Bedarf auch Bilder zur Analyse hochladen kann. Außerdem kann ich über eins der Icons am linken Rand in den weiteren verfügbaren Modellen stöbern und sie herunterladen.

Auch in Kdenlive nutze ich lokale KI, wenn ich die Audiospur eines Videos mit Whisper transkribiere. Das kann ich dann für andere Zwecke weiterverarbeiten oder Untertitel daraus generieren. Wie ich Whisper in Kdenlive eingerichtet habe, erzählen dieser Blogbeitrag und das folgende Video.

DaVinci Resolve bringt noch einiges mehr an KI-Funktionen mit, beispielsweise in DaVinci Resolve Photo – zumindest in der Studioversion. Da sind auch KI-Übergänge, Transkription, das Entfernen von Objekten und einiges mehr verfügbar.

Klar, nicht alles was Sprachmodelle so von sich geben, ist wahr. Leider trifft das aber auch oft auf das zu, was Menschen so erzählen. Und natürlich können lokale Sprachmodelle es nicht in jeder Hinsicht mit Online-Chatbots aufnehmen. Sie können zum Beispiel keine Online-Quellen durchsuchen.

KI-Hilfe bei Linux-Problemen

Wer seinen Kopf nicht benutzt, verlernt das allmählich. Diese Theorie trifft laut einem Artikel in der Zeit auch zu, wenn KI verwendet wird. Wenn ich also statt selbst nachzudenken, mir Fragen von KI beantworten lasse, dann verlerne ich das Denken allmählich. Dabei spielt es allerdings auch eine Rolle, wie und wofür KI genutzt wird.

Gezielte Recherchen anstellen, neue Dinge lernen, sich die Welt erklären lassen, ist auf jeden Fall etwas völlig anderes, als jegliche Problemlösungskompetenz an die KI zu delegieren. Bleiben wir beim Thema Linux: Beim Troubleshooting unter Linux kann KI eine große Hilfe sein. Wer aber einfach Befehle aus einer KI-Antwort in sein Terminal kopiert, lernt dabei nichts und schafft mit etwas Pech weitere Probleme. Ich greife vor allem dann auf KI zurück, wenn ich keinen Ansatzpunkt habe. Dann tippe ich alle Fakten, die mir einfallen ein und frage, welche Ursachen das Problem haben könnte. Und da viele Linux-Distributionen – zum Beispiel Arch Linux oder CachyOS – eine ausgezeichnete Dokumentation haben, es jede Menge Foren, Reddit- oder Stackoverflow-Beiträge und Linux-Blogs gibt, hat eine KI viel Material, aus dem sie schöpfen kann. Das selbst zu sichten würde ewig dauern.

Wenn dabei ein Ansatzpunkt auftaucht, nutze ich die KI, um das Problem einzugrenzen. Lasse mir Befehle vorschlagen, die die entsprechenden Informationen liefern. Dabei tippe ich grundsätzlich nichts ein, von dem ich nicht weiß, was es tut. Wenn ich einen Ansatzpunkt habe, lese ich oft selbst im Arch- oder CachyOS-Wiki weiter, um zu verstehen, was los ist.

Werkzeuge richtig nutzen

Mit Hilfe eines Chatbots kann ich in kurzer Zeit Dinge über die Welt lernen, die mir sonst entgangen wären. Etwa weil mir schlicht die Zeit fehlt, Einzelheiten über das Leben und die Fortpflanzung von Weinbergschnecken und Hummeln herauszusuchen.

Und unter Linux kann KI ein ausgezeichnetes Lernwerkzeug sein, um die Zusammenhänge besser zu verstehen. Der größte Vorteil: Ein Chatbot ist geduldig und beantwortet stundenlang jede Nachfrage. Und weil ich das Wissen nicht direkt wieder vergessen will, notiere ich mir die Sachen, die mich weitergebracht haben, in Obsidian. So kann ich es später nochmal nachlesen und auch komplexe Probleme nach und nach lösen.

Nutzt Ihr KI-Tools und wenn ja eher lokal oder als Online-Dienst? Wofür verwendet Ihr sie?

Schreibe den ersten Kommentar